El crawl budget es un aspecto crucial que debes tener en cuenta para el SEO. Este artículo explica los fundamentos del crawl budget y cómo optimizarlo para sacarle el máximo partido.

Tabla de contenido

¿Qué es el crawl budget?

Empecemos por la definición de rastreo (crawl). El rastreo es el proceso por el cual los motores de búsqueda como Google envían sus bots (también conocidos como arañas o crawlers) para encontrar y escanear el contenido de un sitio web. Esto incluye imágenes, vídeos, PDFs, etc.

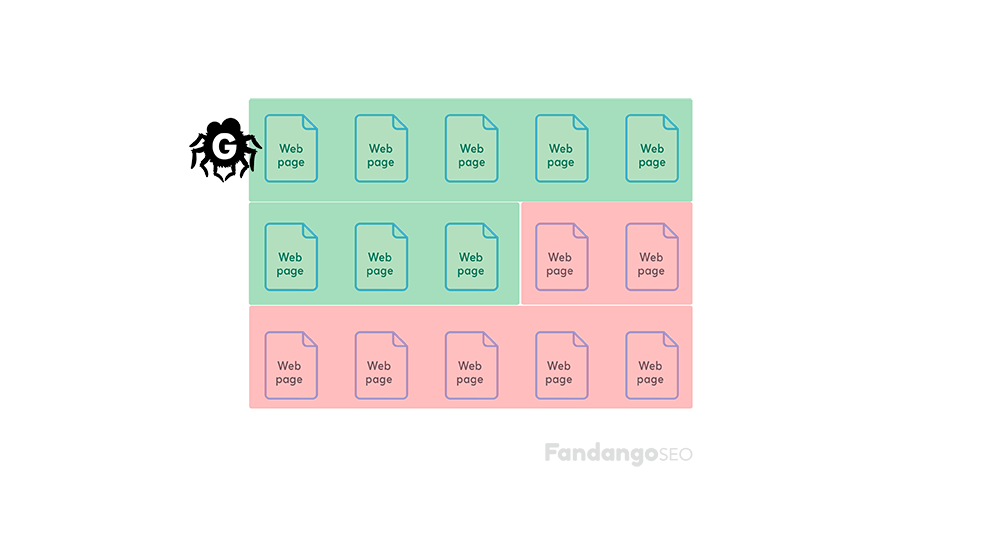

Hay miles de millones de páginas web. Este número hace que sea inviable para Googlebot rastrearlas cada segundo, cada día. Hacerlo conduciría a una cantidad extremadamente alta de ancho de banda consumido online. Esto, a su vez, conduciría a sitios web de menor rendimiento. Para evitar esta situación, Google asigna un crawl budget para cada sitio web. El presupuesto asignado determina el número de veces que Googlebot rastrea el sitio web mientras busca páginas para indexar.

Un Googlebot, por otro lado, es un proxy automatizado que rastrea un sitio mientras busca páginas que deban añadirse a su índice. Es algo que actúa como un surfista web digital. Saber sobre Googlebot y cómo funciona es solo un paso para ayudarte a entender la idea de los crawl budgets para el proceso de SEO.

Cómo medir tu crawl budget

La mejor manera de medir el crawl budget es realizando un análisis de logs. Esta es una práctica vital para ver cómo se comporta Google en tu sitio web y en qué páginas gasta el crawl budget.

Usando un Analizador de Logs como FandangoSEO, puedes comprobar al instante los hits medios (visitas de Googlebot) a tu sitio por día y hora o evaluar cómo se distribuye tu crawl budget entre los diferentes tipos de página. Del mismo modo, podrás ver los rastreos del motor de búsqueda en tiempo real para confirmar si se encuentra tu contenido más reciente.

¿Por qué es importante el crawl rate limit?

Este concepto tiene algunas diferencias en comparación con el crawl budget. El límite de la crawl rate define el número de conexiones simultáneas que utiliza Googlebot para rastrear sitios y el tiempo que tarda antes de obtener otra página. Debes tener en cuenta que Google se centra en la experiencia del usuario. Por lo tanto, Googlebot utiliza el límite de la crawl rate. Este límite evita que los agentes automatizados invadan los sitios hasta el punto de que a los usuarios humanos les resulte difícil cargar un sitio en sus navegadores web.

Algunos factores afectarán a la crawl rate. Algunos de ellos incluyen:

- Velocidad del sitio web – Si los sitios web responden rápidamente a Googlebot, entonces Google ampliará el límite de la crawl rate. Google reducirá entonces la crawl rate para otros sitios web lentos.

- Ajustes en Search Console – Un desarrollador o arquitecto web puede establecer los límites de rastreo a través de Search Console. Si un webmaster piensa que Google está sobre-rastreando su servidor, puede disminuir la crawl rate, pero no puede aumentarla.

Ten en cuenta que una crawl rate saludable puede conseguir que las páginas se indexen más rápido, pero una crawl rate más alta no es un factor de ranking.

La demanda de rastreo

Es posible que no se alcance el límite de la crawl rate, pero seguirá habiendo una actividad reducida por parte de Google si no hay demanda de indexación. Esta reducción de la actividad del Googlebot se denomina reducción de la demanda de rastreo. Los dos factores que determinan significativamente la demanda de la crawl rate son:

- Popularidad– Las URLs populares en Internet se rastrean con frecuencia para mantenerlas siempre actualizadas en el índice de Google.

- Antigüedad– Los sistemas de Google generalmente intentan evitar que las URLs se vuelvan obsoletas en su índice.

Además, incidentes en todo el sitio, como cambios de sitio, pueden activar un aumento en la demanda de rastreo. Esto sucede para reindexar el contenido del sitio en las nuevas URLs.

¿Qué factores afectan al crawl budget para SEO?

Un crawl budget combina la demanda de rastreo y la velocidad de rastreo. Esta combinación es lo que Google define como el número total de URLs que Googlebot está dispuesto y puede rastrear. Google ha identificado los factores exactos que afectan el crawl budget. Aquí está la lista de esos factores:

- Parámetros de la URL – Este es principalmente el caso en que la URL base agregada con parámetros devuelve la misma página. Este tipo de configuración puede llevar a varias URLs únicas que cuentan para un crawl budget, aunque esas URLs sigan devolviendo la misma página.

- Páginas de error soft – Estas páginas de error también tienen un impacto en el crawl budget. Sin embargo, también se informan en Search Console.

- Contenido duplicado – A veces, las URLs pueden ser únicas sin parámetros de solicitud, pero aún así devuelven el mismo contenido web.

- Páginas hackeadas – Los sitios hackeados generalmente tienen su crawl budget limitado.

- Contenido de baja calidad – Es probable que Google limite el crawl budget para los sitios que sufren de baja calidad.

- Paginación infinita– Los sitios con enlaces ilimitados encontrarán que Googlebot gasta gran parte de su crawl budget en los enlaces que podrían no ser importantes.

¿Cómo optimizar tu crawl budget?

Afortunadamente, existen pautas simples que se pueden poner en práctica para optimizar tu crawl budget de Google. Especialmente las que vamos a ver a continuación:

Comprueba que tus páginas principales sean rastreables

Es vital asegurarse de que .htaccess y robots.txt no bloqueen tus páginas más importantes y que los bots no tengan problemas para acceder a los archivos CSS y Javascript. También debes tener cuidado de bloquear el contenido que no debe mostrarse en la SERP. Recomendamos utilizar un SEO Crawler que te permita detectar fácilmente cualquier problema de rastreo.

Dale una estructura sencilla a tu sitio web

Tu sitio debe tener una página de inicio, categorías o etiquetas y páginas de contenido. Incluye enlaces internos para establecer una jerarquía del sitio y facilitar que los rastreadores encuentren las páginas. Nuevamente, sugerimos usar una herramienta SEO que te permita ver la estructura de tu sitio de un vistazo.

No dejes de actualizar tu sitemap XML

Actualizar el sitemap XML es esencial, ya que esto ayuda a los bots a comprender a dónde van los enlaces internos en el sitio. Esta práctica también permite que Google indexe y clasifique las nuevas páginas más rápidamente.

Evita las cadenas de redireccionamiento

No es nada recomendable que tu sitio tenga redirecciones 301 y 302. Es posible que apenas notes si ocasionalmente dejas una o dos redirecciones, pero no debes dejar que el número siga creciendo.

Gestiona tus parámetros URL correctamente

En caso de que tu sistema de gestión de contenido genere una gran cantidad de URLs dinámicas, podrían conducir a una sola página. Pero los motores de búsqueda las tratarán por separado, gastando tu crawling budget innecesariamente. Entonces, para evitar problemas de contenido duplicado, debes administrar tus parámetros de URL correctamente.

Elimina las páginas de error 404 y 410

Estos tipos de páginas desperdician tu crawl budget y también pueden dañar la experiencia del usuario. De ahí la importancia de corregir los códigos de estado 4xx y 5xx.

Reduce la velocidad de carga del sitio

La velocidad del sitio es de fundamental importancia para mejorar el crawl budget y para que tu sitio web se clasifique alto. Los bots rastrean mucho más rápido aquellas páginas que se cargan más rápidamente. También es un factor crítico para mejorar la experiencia del usuario y, por lo tanto, el posicionamiento de la página.

Utiliza los feeds a tu favor

Google dice que los feeds son una forma para que los sitios web grandes y pequeños distribuyan contenido más allá de los visitantes que recurren a los navegadores. Permiten suscripciones a actualizaciones periódicas entregadas automáticamente a través de un portal web, un lector de noticias e incluso a veces un correo electrónico antiguo.

Estos feeds son muy útiles para los rastreadores, ya que se encuentran entre los sitios más visitados por los bots de los motores de búsqueda.

Incluye enlaces internos que apunten a las páginas con menos tráfico

No hay duda de que el enlazado interno es una gran estrategia SEO. Mejora la navegación, distribuye la autoridad de la página y aumenta la participación del usuario. Pero también es una buena táctica para mejorar el crawl budget, ya que los enlaces entrantes abren el camino para el rastreador mientras navega por el sitio.

Crea enlaces externos

Los estudios han demostrado una fuerte correlación entre la cantidad de veces que las arañas pasan por un sitio web y la cantidad de enlaces salientes que contiene.

¿Cómo aumentar tu crawl budget?

Matt Cutts, quien fue jefe del equipo de Web Spam de Google, explicó este tema hablando de la relación entre el crawl budget y la autoridad. Argumentó que el número de páginas rastreadas es más o menos proporcional a su PageRank.

Como explicó Cutts, si hay muchos enlaces entrantes en la página raíz, se rastrean. Entonces, esta página raíz puede apuntar a otras, que obtendrán PageRank y también se rastrearán. Pero PageRank disminuirá a medida que profundices en el sitio.

Bueno, aunque Google ahora actualiza públicamente los valores de PageRank, este parámetro todavía está presente en los algoritmos del motor de búsqueda. Hablemos de la autoridad de la página en lugar de PageRank: la conclusión es que está estrechamente relacionada con el crawl budget.

Por lo tanto, está claro que debes aumentar la autoridad del sitio para obtener un mayor crawl budget. Esto se logra en gran medida con más enlaces externos.